Tradução de Thought experiment in the National Library of Thailand.

Com o advento do ChatGPT, os grandes modelos de linguagem (LLMs) passaram de um tema relativamente de nicho para algo com que muitas, muitas pessoas já tiveram contato. O ChatGPT é apresentado como um sistema divertido para conversar, um parceiro de diálogo e (por meio do Bing) uma interface de busca.* Mas, fundamentalmente, trata-se de um modelo de linguagem, ou seja, um sistema treinado para produzir sequências prováveis de palavras com base nas distribuições presentes em seus dados de treinamento. Como ele modela essas distribuições com grande precisão, é bom em gerar textos que soam plausíveis, em diferentes estilos. Mas, como sempre, se esse texto faz sentido, é porque nós, os leitores, estamos interpretando-o.

Em Climbing Towards NLU: On Meaning, Form, and Understanding in the Age of Data (2020), Alexander Koller e eu defendemos que tais sistemas não têm como aprender o significado (seja “compreender” suas entradas ou expressar intenção comunicativa), pois seu regime de treinamento consiste apenas na forma da linguagem. A distinção entre forma e significado nos sistemas linguísticos é sutil, sobretudo porque, uma vez que nós (humanos!) aprendemos uma língua, assim que vemos ou ouvimos qualquer forma nessa língua, acessamos imediatamente o significado também.

Mas só conseguimos fazer isso porque aprendemos o sistema linguístico ao qual a forma pertence. No caso de nossas línguas maternas, esse aprendizado ocorreu em interações socialmente situadas e corporais, que nos permitiram dar os primeiros passos no sistema linguístico e que se prolongaram por meio de outras interações socialmente situadas e corporais, incluindo algumas nas quais usamos o que já sabíamos sobre a língua para aprender mais. No caso de línguas não maternas, podemos ter começado com um ensino que aproveitou explicitamente nossas habilidades na língua materna.

No entanto, quando vemos um modelo de linguagem produzindo resultados aparentemente coerentes e pensamos em seus dados de treinamento, se esses dados vierem de uma língua que falamos, é difícil manter em foco o fato de que o computador está apenas manipulando a forma — e a forma não “carrega” o significado, exceto para alguém que conheça o sistema linguístico.

Para tentar esclarecer a diferença entre forma e significado, gosto de propor às pessoas um experimento mental. Pense em uma língua que você não fala e que, além disso, é escrita em um sistema de escrita não ideográfico que você não sabe ler. Para muitas (mas de forma alguma todas) as pessoas que estão lendo este post, o tailandês pode se encaixar nessa descrição; por isso, vou usar o tailandês neste exemplo.

Imagine que você está na Biblioteca Nacional da Tailândia (página da Wikipédia). Você tem acesso a todos os livros daquela biblioteca, exceto aqueles que contêm ilustrações ou textos que não estejam em tailandês. Você dispõe de tempo ilimitado e suas necessidades físicas estão atendidas, mas não há ninguém com quem interagir. Você conseguiria aprender a compreender o tailandês escrito? Se sim, como você conseguiria isso? (Por favor, reflita por um momento antes de continuar a leitura.)

Já tive essa conversa com muitas pessoas. Algumas sugestões que surgiram:

- Procure uma enciclopédia ilustrada. [Desculpe, mas tirei todos os livros com fotos, lembra?]

- Encontre artigos científicos que possam conter palavras emprestadas do inglês escritas com a ortografia inglesa. [Esses também já foram eliminados. Fui bem minuciosa.]

- Compile pacientemente uma lista de todas as sequências de caracteres, identificando as mais frequentes, e deduza que essas são palavras funcionais, como os equivalentes a “e”, “o” ou “para”, ou quaisquer outros elementos que a língua tailandesa gramaticalize. [Na verdade, o tailandês não usa espaços em branco como delimitadores de palavras, então essa estratégia seria ainda mais desafiadora. Se você tivesse sucesso, seria porque estaria trazendo conhecimento adicional para a situação, algo que um LLM não possui. Além disso, as palavras funcionais não vão te ajudar muito em termos do conteúdo propriamente dito.]

- Tempo ilimitado e comida tailandesa deliciosa? Eu simplesmente relaxaria e aproveitaria isso. [Ótimo! Mas, por outro lado, isso não vai ajudar a aprender tailandês.]

- Procure até encontrar algo que, pelo formato, seja claramente uma tradução de um livro que você já conhece bem em outro idioma. [Mais uma vez, trazendo informações externas.]

- Observe como os livros estão organizados na biblioteca e identifique palavras (subsequências) que apareçam de forma desproporcional em cada seção (em comparação com as outras). Conclua que essas são as palavras relacionadas ao tema daquela seção. [Essa seria, sem dúvida, uma maneira interessante de dividir o vocabulário, mas como você descobriria, na prática, o significado dessas palavras?]

Sem nenhuma maneira de relacionar os textos que você está analisando com algo fora da linguagem, ou seja, com hipóteses sobre sua intenção comunicativa, não dá para avançar nessa tarefa. A maioria das estratégias acima envolve recorrer a informações adicionais que permitam formular essas hipóteses — algo que vai além da forma estrita da linguagem.

Se você não desistisse, poderia chegar a ter uma boa noção de como “é” uma sequência razoável de palavras em tailandês. Talvez até conseguisse escrever algo que um falante nativo de tailandês conseguisse entender. Mas isso não é o mesmo que “saber tailandês”. Se quisesse aprender com o conhecimento armazenado naquela biblioteca, você ainda não teria acesso a ele.

Quando você lê o resultado do ChatGPT, é importante lembrar que, apesar de sua aparente fluência e de sua capacidade de criar sequências de texto que soam convincentes, estão dentro do tema e parecem respostas às suas perguntas, ele está apenas manipulando a forma linguística. O sistema não está entendendo o que você perguntou nem o que está respondendo, muito menos “raciocinando” a partir da sua pergunta e do seu “conhecimento” para chegar à resposta. O único conhecimento que ele possui é o conhecimento da distribuição da forma linguística.

Não importa o quão “inteligente” ele seja — ele não consegue chegar ao significado se tudo a que tem acesso é a forma. Mas também: ele não é “inteligente”. Nossa única evidência de sua “inteligência” é a aparente coerência de sua saída. Mas somos nós que estamos criando todo o significado ali, à medida que damos sentido a ele.

* Essa é, na verdade, uma péssima ideia. Chirag Shah e eu expomos os motivos em Situating Search (CHIIR 2022) e neste artigo de opinião.

Pós-escrito: Depois que isso foi compartilhado no Twitter e no Mastodon, várias pessoas nessas plataformas responderam dizendo: “Isso é apenas o experimento da Sala Chinesa de Searle”. Eis em que difere:

Não estou perguntando se, em princípio, um computador poderia ser programado para compreender. (Na verdade, pela definição de compreensão em Bender & Koller 2020, quando você pede a um assistente virtual para ajustar um cronômetro, acender uma luz etc. e ele o faz, ele compreendeu.) Estou perguntando se qualquer entidade (pessoa, computador, polvo hiperinteligente das profundezas do mar), exposta apenas à forma, poderia aprender o significado, ou seja, aprender a compreender.

O experimento mental de Searle pressupõe que as regras linguísticas já estão disponíveis e questiona se aplicá-las equivale a compreender (e, a partir daí, tira conclusões sobre a possibilidade da inteligência artificial).

Já apontamos isso em Bender & Koller 2020:

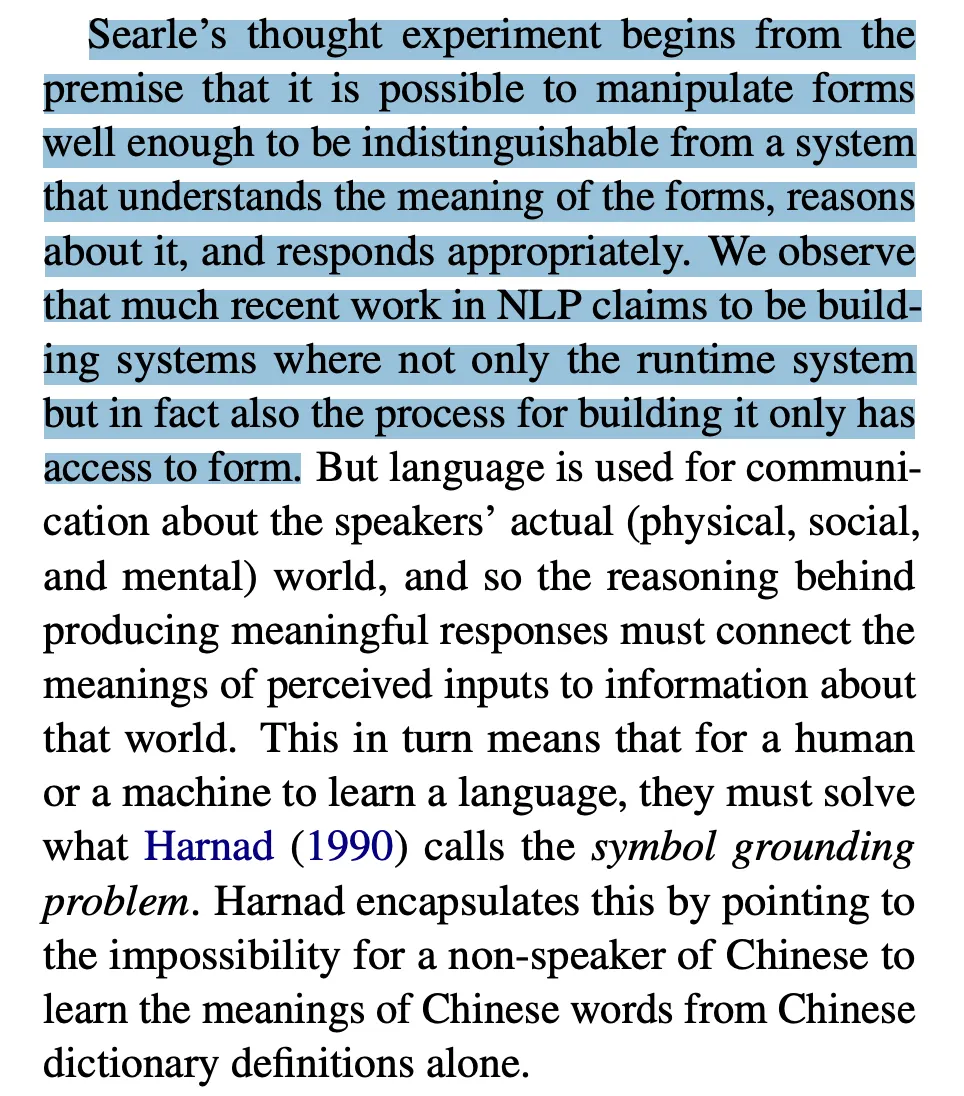

((Tradução do texto da imagem: O experimento mental de Searle parte da premissa de que é possível manipular formas de maneira tão eficaz que se tornem indistinguíveis de um sistema que compreenda o significado dessas formas, raciocine sobre ele e responda adequadamente. Observamos que muitos trabalhos recentes em PLN afirmam estar construindo sistemas nos quais não apenas o sistema em execução, mas também o próprio processo de construção, tem acesso apenas à forma. Mas a linguagem é usada para a comunicação sobre o mundo real (físico, social e mental) dos falantes e, portanto, o raciocínio por trás da produção de respostas significativas deve conectar os significados das entradas percebidas às informações sobre esse mundo. Isso, por sua vez, significa que, para um ser humano ou uma máquina aprender uma língua, eles devem resolver o que Harnad (1990) chama de problema da fundamentação de símbolos. Harnad resume isso apontando para a impossibilidade de alguém que não fala chinês aprender os significados das palavras chinesas apenas a partir das definições de um dicionário chinês.))

Captura de tela de Bender & Koller 2020, página 4, primeira coluna, terceiro parágrafo, que começa com “O experimento mental de Searle”. Fonte: https://aclanthology.org/2020.acl-main.463.pdf.

Para mim, a inteligência é irrelevante/ortogonal: supõe-se que o polvo e o ocupante da Biblioteca Nacional da Tailândia sejam inteligentes. Um modelo de linguagem, não. A conexão com a inteligência só surge porque as pessoas estão atribuindo inteligência aos modelos GPT (“faíscas de IGA”, “LaMDA é senciente”, “ligeiramente consciente”, blá blá blá) com base em sua produção linguística. O experimento mental da Biblioteca Nacional da Tailândia tem como objetivo mostrar que se trata apenas de um truque de salão.

Em outras palavras, estou escrevendo no contexto de 2019–2023, onde ficou muito claro que precisamos nos proteger contra nossa tendência de atribuir uma mente por trás das palavras, uma vez que elas sejam fluentes o suficiente.

Feedback e ajuda

Quer comentar? Manda um e-mail para adolfo @ utfpr.edu.br ou me manda mensagem no Bluesky.

Sou coordenador da Rede Emílias de Podcasts

Quer ajudar os podcasts ou me ajudar a ir a eventos?

Será que vou conseguir ir ao ICSE 2026?